最終更新日:

AIニュースまとめ(7月19日、7月26日週)

こんにちは。スキルアップAIの泉です。

スキルアップAIでは、AIに関するニュースをピックアップし、週間で紹介しております。

今回は、7月19日、7月26日週のAI関連のニュースを紹介していきます。

◇話せない人の脳活動から文章を直接解読、世界初の装置開発

参考記事:話せない人の脳の活動から文章直接解読 世界初の装置開発 米

- 脳卒中で発話能力を失った人の大脳皮質活動を「解読」し、まとまった文章にする神経機能代替装置の開発に世界で初めて成功

この研究の被験者は、20歳の時に脳卒中を患い、認知機能は損なわれていないが明瞭に話すことができない「講語障害」がある男性でした。 男性は脳幹卒中の後遺症で、頭や首、手足をほとんど動かせなくなり、今は帽子に取り付けた棒で画面に表示された文字を指して意思疎通を行っています。

研究チームは「水」「家族」「良い」など、男性が毎日必ず使用する言葉50語をまとめた語彙集を作成しました。 また、男性の脳の発話を司る運動皮質に高密度の電極を埋め込み、これらの言葉を男性が言おうとした際の神経活動を数か月かけて記録したそうです。 さらに、AIを用いて記録したデータの差異を判別し、単語と結び付けました。

その後、男性に語彙集に含まれる単語だけで作った文章を提示し、男性が言おうとした言葉が画面上に表示されるかを確認した結果、1分間に最大18語を解析することができ、正確性は平均75%でした。

この研究の類似テーマを調査していたときに、「脳波から文章を生成するAI」のことを「テレパシーの開発」と例えている記事を見つけました。 脳波を解析して、その差異を学習させて…と、研究の概要を理解できる現代人ではない昔の人が見たら本当にびっくりしそうです。

語彙集の作成方法を工夫して、言葉を話せない動物の言いたいことも分かったら面白そうです。

例えば、犬がご飯を見せた際の脳波や、怯えているときの脳波などを計測した簡単な語彙集を作成し、今回のAIを利用して、犬が何を考えているか、予測できたら嬉しいです。

また、今回は被験者が1名でしたが、大勢のデータを集めたデータセットを作れば、データセットに含まれていない人の脳波でも、同じように解析ができるのでしょうか。

この技術を商品化して、多くの意思疎通が難しい患者さんが使えるようになれば良いな、と思います。

◇ラベルの自動認識AIアルゴリズムを提供開始

ニュースリリース:【東大発AIベンチャー】ラベルの自動認識AIアルゴリズムを提供開始

- SMITH & FACTORY株式会社が、ラベルの自動認識AIアルゴリズムを提供開始

- アイテムを撮影した画像から、荷姿、ラベルの位置・種類に囚われないラベル内情報の自動読みとりが可能に

- ラベルを取り扱うあらゆる工場における、労働力不足の解消・作業コストの軽減・ヒューマンエラーの防止を目指す

現在、様々な工場でロット番号・品質保証期限・賞味期限などを記載した「ラベル」が利用されています。

しかし、工場内で取り扱うアイテムは、荷姿やラベルの位置・種類が多いため、ラベルを自動で読み取ることが難しく、直接人の目で確認せざるをえませんでした。また、人間が行う作業はミスが起こる可能性も大きく、人為的な過誤による損失、作業効率の低下等が課題となっていました。

そこで、OCR(文字認識)技術を利用したラベル自動認識システムが開発されました。

ラベルに書かれた文字をデジタルデータとして活用するには、一度、人間が読み取って文字に変換する必要がありますが、それを人間の代わりに行うのがOCRです。

AIを活用したOCRを導入することで、タブレットなどをかざすだけで文字を認識することができるようになり、人間が担っていた作業をコンピュータが、正確かつ迅速に完遂することが可能になりました。

また、AIを複数のラベルにも対応できるよう学習したため、ラベルの種類の変更や大幅な作業フロー変更の必要がなく、現場にスムーズな導入が可能です。

同社では、ラベルの自動認識以外にも、「ラベルが物流の元データと紐づいてない」という物流の課題解決を目指していました。

これは、ラベルに荷物を搬送する際に必要な受注情報や集荷情報といった決まった情報しか記入されていないことが原因です。ラベルに全ての物流データが記入されていないため、欠品などの問題が起こった時に、人が手作業で処理を行う必要があり、現場の負担が大きくなっているという問題があるそうです。

そのため、画像認識で読み取ったデータを物流システムと連携させることで、欠品などのミスが起こった場合もアプリを通じて自動的認識・異常感知を行い、AI自らが問題を修正することを実現したそうです。

今回の画像認識技術では、ラベル内の情報を自動で読み取っています。

工場内の光の加減や、ラベルの紙の質感が統一されていない画像から、まず「ラベルがどこにあるのか」を正確に認識し、「ラベル内の情報を読み取る」技術がすごいなと思いました。

記事内でラベル内の情報の例としてロット番号・品質保証期限・賞味期限などが挙げられていたので、現在は数字などを中心に認識しているのでしょうか。

物流システム内のデータと紐づけするために、ラベル内のなるべく詳しい情報を自動認識できれば、より便利になりそうです。

アルファベット、ひらがな、カタカナ、漢字なども自動認識できるようになると、店舗などの現場で行う、配送された商品確認などの作業も完全に自動化できるのではないでしょうか。

参照、引用元:

【東大発AIベンチャー】物流で用いる仕分けシステム用の荷札ラベル自動認識AIアルゴリズムの提供を開始

【TRUST SMITH×ADEKA】ラベル自動認識システムの実証実験スタート

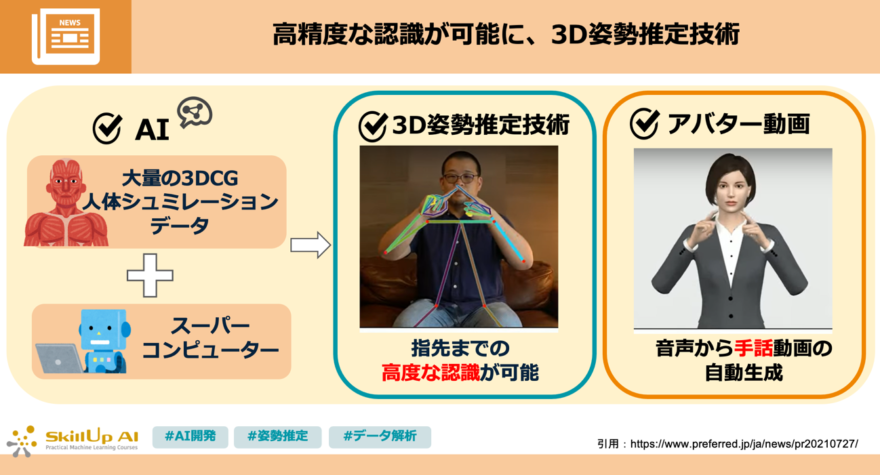

◇株式会社Preferred Networks、指先の向きや手の重なりまで認識できる3D姿勢推定技術を開発

ニュースリリース:指先の向きや手の重なりまで認識できる3D姿勢推定技術を開発

- 株式会社Preferred Networkが、深層学習を活用した身体の動きや指先の向きまで高精度に認識する3D姿勢推定技術を開発

株式会社Preferred Networkが、全身を総合的に認識できる高度な3D姿勢推定モデルの開発を行いました。3DCGによる人体シミュレーションで作成した大量の学習データを、PFNのスーパーコンピュータで学習しています。

この技術では従来必要であった専用カメラによる撮影や、身体へのセンサー装着の必要がないそうです。

また、課題であった「指先の向き」や「両手が重なる場面などでの誤検出」を大幅に削減し、身体の細部の動きの高精度追跡を可能にしました。

実は、この3D姿勢推定技術は、ソフトバンク株式会社が開発する、「手話と音声による双方向コミュニケーションシステムSureTalk」に採用されています。 手話では指の動きや手の重なりが語彙の意味に影響するので、指先まで認識できる高度な3D姿勢推定技術を利用して自動生成された手話アバター動画を公開しています。

以前、身体の3次元位置を測定するためにMAC3D Systemを利用したことがあります。その時、位置を測定したい身体の部位にマーカーを取り付けたり、キャリブレーションを行ったりするのに時間と手間がかかって大変だと感じました。

それと比較しても、今回の技術では画像などから身体の部位の高精度な追跡が可能なので、大掛かりな設備がいらず、広く活用できそうですね。

記事でも言及されていましたが、楽器演奏や、スポーツ解析、細かな手作業の技術継承、遠隔診断・リハビリなどへの活用が楽しみです。

参考サイト:SureTalkができること

◇花王「肌評価AI」により、マスク着用時は顔全体で化粧くずれが起きやすくなることが明らかに

ニュースリリース:花王独自の「肌評価AI」※1によりマスク着用時は顔全体で化粧くずれが起きやすくなることが明らかに

- 花王株式会社メイクアップ研究所は、独自開発した「肌評価AI」を用いて、マスク着用時の化粧くずれの実態を調査

- マスク着用時には、マスク内の蒸れやこすれ、マスクからのぼる呼気によって顔全体で化粧くずれが起きやすくなっていることが明らかに

花王株式会社メイクアップ研究所は、深層学習を用いて、肌の見た目の印象を客観的・定量的に評価し、画像化する「肌評価AI」を開発しました。この技術を応用することで、化粧感、化粧くずれの程度、年齢印象などの客観的評価が可能です。

同社では、肌の見た目印象を評価するように学習させることで、「肌評価AI」を構築できるのではないかと考え、開発を行なっていました。AIでは入力された画像全体から、線、点、角度、周波数などさまざまな情報を抽出し、複雑な計算を繰り返して、最終的な評価結果を導き出しますが、その評価は肌以外の情報に影響されている可能性があります。

そこで、肌のみを解析・評価対象にするため、顔全体ではなく元の顔画像から小領域を切り出した画像“肌パッチ”を用いる方法を検討したそうです。

これによって、顔の部位ごとの解析・画像化が可能なので、それをシステムの総合評価の根拠としています。

花王は、VGG16(16層の画像認識モデル)を利用し、「化粧感評価AI」の構築に取り組みました。

1. 最適な肌パッチのサイズの検討

まず、化粧感を評価するのに最適な肌パッチのサイズを検討しました。

20~70代の日本人女性269名の素肌と化粧肌の顔画像を同一の撮影装置で撮影し、8.9×8.9mmから44.5×44.5mmまでの異なるサイズで切り出してデータセットを構築します。

次に、肌パッチサイズごとに、素肌と化粧肌を判別するAIモデルをつくり、それらを学習用画像とは異なる撮影装置・照明条件で撮影した素肌・化粧肌の顔画像に適用し、判別精度を評価しました。

その結果、17.8mmの肌パッチで学習したモデルの精度が最もよいことがわかりました。

2.「化粧感評価AI」の構築

20~70代の日本人女性512名のベースメイク塗布前後の画像を撮影し、この画像の17.8mm四方の領域を切り出して計43,897枚からなる「肌パッチ」を作成し、AIに学習させました。

その結果、1枚1枚の肌パッチが素肌であるか、化粧肌であるかの判別率は92.7%の精度でした。

今回は、「肌解析AI技術」を用いて、以下2つの実験が行われました。

- マスク着用時の化粧くずれ実態をAI技術で可視化

- 使用アイテムの工夫による化粧もち効果

その結果1では、マスク着用の際は、マスクに覆われている鼻周りだけでなく、マスクに覆われていない顔の上半分まで、広範囲に化粧くずれが起きていることがわかりました。

これは、マスク内が蒸れたり、マスクでこすれたりすることに加え、マスクからもれ出た呼気が顔上部にのぼってくるためと考えられます。マスク着用時には、化粧くずれをしっかりと防ぐメイクアップが必要であることがわかります。

2の結果では、マスク着用による化粧くずれは、化粧下地や、皮脂を吸着するフェースパウダーの利用で防ぐことができることがAIによって確認されました。

AIが判断を下す際の根拠がブラックボックス化されてしまうことは、大きな課題の1つだと思いますが、入力データを工夫することでそれを解決している点がすごいと思います。

また、顔の部位ごとに区切った点も、詳しい解析結果を知ることができるのでとても有用です。

引用、参考元URL:

多様で繊細な肌の質感を評価・可視化する「肌評価AI」を開発

化粧感、化粧くずれの程度、年齢印象などを精度よく判別

おわりに

いかがだったでしょうか?

スキルアップAIでは、関連講座として「現場で使えるディープラーニング基礎講座」を開講中です。ディープラーニングの基礎・原理を理解し、ディープラーニングを支える最先端の技術をプログラミングレベルでマスターすることをゴールとした講座です。

また、「現場で使えるAIプランニング・プロジェクト推進基礎講座(DataRobot活用編)」は、AIのビジネス活用においてスキルアップAIが体系化した知識をもとにAIプロジェクトの計画から DataRobot を使ったPoC実践まで、実際のAIのビジネス活用の流れを体感できるワークや座学を行う内容になっています。是非ご検討ください。

今後も、AI関連ニュースの記事を共有していきたいと思います。ご期待ください!

配信を希望される方はこちら

また、SNSでも様々なコンテンツをお届けしています。興味を持った方は是非チェックしてください♪

公開日: