機械学習技術の発展に伴い、近年では採用やローン審査など、社会的に重要な意思決定プロセスの中においても機械学習が用いられる事例が増えつつあります。その一方で、学習した機械学習モデルが、学習データに含まれる人間の偏見をそのまま反映してしまうことによる問題が表面化しました。今後、機械学習システムが社会に受け入れられるためには、予測の公平性(fairness)を実現する必要があります。

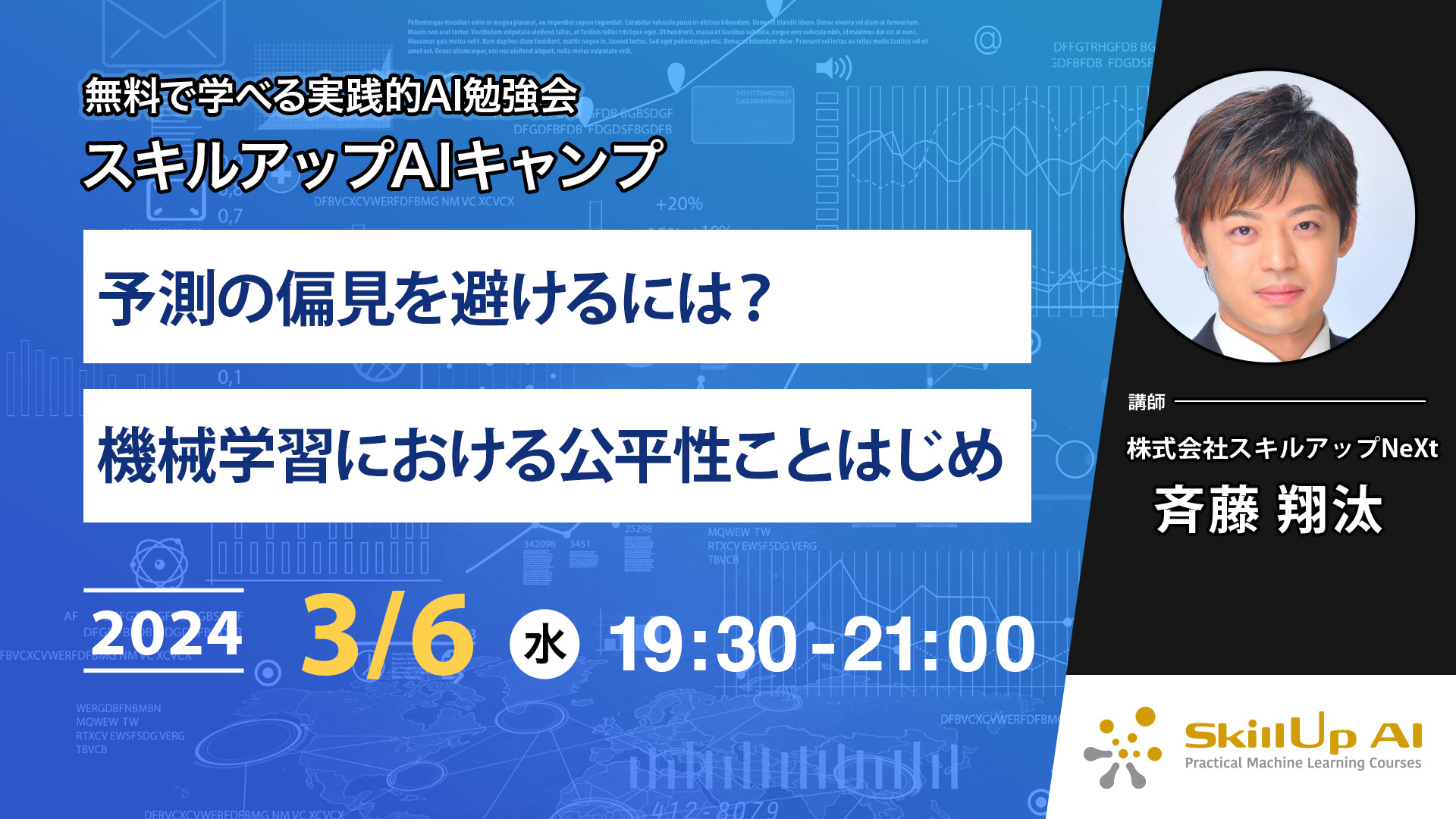

そこで、今回のスキルアップAIキャンプでは、不公平が発生する要因から公平性を考慮した機械学習モデルの学習方法までを概観し、その勘所をお伝えします。

プログラム概要

- 公平性(fairness)がなぜ必要とされるのか?

- 不公平の発生要因

- 公平性の定義

- 公平性配慮型機械学習の代表的手法

- 公平性配慮型機械学習を実装するための Python ライブラリ

- ハンズオン|Fairlearnに公平性配慮型機械学習の実装

※一部変更となる場合がございます。

スピーカー

-

株式会社スキルアップNeXt/斉藤 翔汰

スキルアップAI講師。横浜国立大学大学院 環境情報学府 情報メディア環境学専攻(現:情報環境専攻)修了。修士(情報学)。高専時代に画像認識に対して興味を持ったことがきっかけで、現在はDeep Learningや機械学習、進化計算などの人工知能分野におけるアルゴリズムの研究開発やコンサルティングに従事。日本ディープラーニング協会の2018年度・2019年度E資格合格者、2018年度G検定合格者。著書「徹底攻略ディープラーニングE資格エンジニア問題集」(インプレス)。

開催概要

日時

2024年3月6日(水)19:30~21:00

開催方法

Zoom

参加費

無料

※競合他社様のご参加は、ご遠慮いただいておりますので、ご了承ください。